ELEGANT – 6G-OpenLab: Una infraestructura única como banco de pruebas en condiciones reales para aplicaciones 6G

octubre 29, 2024

MOST: Un dispositivo híbrido único para generar electricidad y almacenar energía térmica de forma eficiente y sostenible

noviembre 25, 202422/11/2024

El consumo de energía en el entrenamiento e inferencia de modelos de inteligencia artificial (IA), como por ejemplo, los modelos extensos de lenguaje (Large Language Models - LLM) como GPT-4, se ha convertido en un desafío crucial debido al impacto ambiental y a los costos asociados a la computación de alto rendimiento (High Performance Computing - HPC). El consumo de energía necesario para entrenar estos modelos e interaccionar con ellos aumenta considerablemente a medida que estos crecen en tamaño y complejidad.

El entrenamiento de un modelo de IA consiste en alimentar las redes neuronales que lo forman con grandes volúmenes de datos y realizar múltiples iteraciones entre ellos para optimizar los parámetros del modelo y mejorar sus resultados. Estas tareas requieren una enorme capacidad de procesamiento, lo que consume una cantidad muy significativa de electricidad. Según Schwartz et al., el costo de entrenar modelos de Aprendizaje Automático (en inglés, Machine Learning - ML), en términos de recursos informáticos utilizados, aumentó 300.000 veces en solo 6 años (2013-2019), duplicándose cada 3,4 meses. Según estudios más recientes, estos costos siguen creciendo hasta una tasa anual de 2,4 veces desde 2016. Si nos centramos exclusivamente en los sistemas de IA, y pensando en un escenario intermedio, para 2027 los centros de datos y servidores con modelos de IA consumirán entre 85 y 134 teravatios hora (TWh) al año. Esta cifra es comparable al consumo anual de electricidad de países como Argentina, los Países Bajos o Suecia, y representa aproximadamente el 0,5 % del consumo eléctrico mundial actual.

Sin embargo, para comprender completamente el verdadero impacto ambiental, debemos considerar el ecosistema de ML de manera holística, más allá del entrenamiento de modelos, y tener en cuenta la huella de carbono operativa del ML. Así, la inferencia, que es el uso de un modelo entrenado para realizar predicciones en tiempo real, también puede consumir cantidades significativas de energía, especialmente en aplicaciones a gran escala. Aunque el consumo de energía requerido por una única inferencia es mucho menor que durante el entrenamiento, el uso continuo y extendido en entornos como los sistemas de atención al cliente, la generación de contenido o la conducción autónoma, puede acumular un impacto energético mayor. De hecho, para servicios como ChatGPT, la inferencia constituye la causa principal de las emisiones, produciendo en un año 25 veces las emisiones de carbono requeridas en su entrenamiento, según Chien et al.

Este elevado consumo de energía tiene varias implicaciones:

- Costes Económicos: El entrenamiento de modelos a gran escala es caro debido a los altos requerimientos de hardware y la energía necesaria para alimentar los centros de datos.

- Impacto Ambiental: El uso masivo de electricidad en entrenamientos prolongados contribuye a las emisiones de carbono, especialmente si la fuente de energía no es renovable. Esto afecta a la sostenibilidad de la IA.

- Optimización: Se deben desarrollar métodos de entrenamiento e inferencia más eficientes, incluyendo la optimización de modelos, el uso de hardware especializado como GPUs y TPUs, y la adopción de estrategias como el aprendizaje federado y la compresión de modelos.

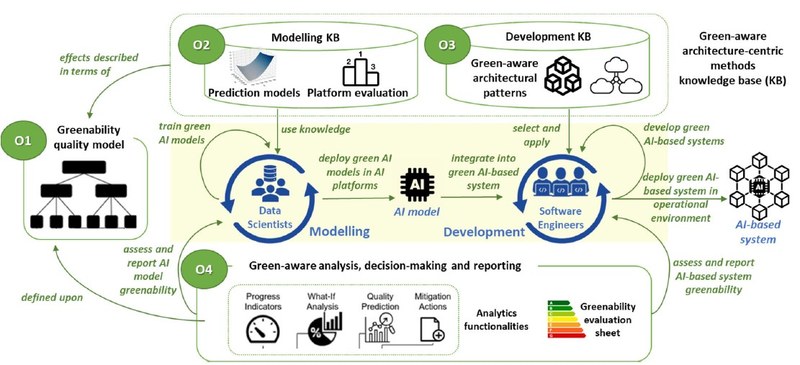

En este contexto, el grupo de investigación Software and Service Engineering Group(GESSI) de la Universitat Politècnica de Catalunya - BarcelonaTech (UPC) trabaja en GAISSA, un proyecto en cuyo marco se ha desarrollado la herramienta informática GAISSALabel. Se trata de una tarjeta energética que evalúa la eficiencia energética tanto en las fases de entrenamiento como de inferencia de cualquier modelo de aprendizaje automático, algo que es especialmente útil para los servicios de HPC. GAISSALabel es capaz de evaluar la huella de los modelos de aprendizaje automático, contribuyendo a mejorar su eficiencia, reducir los costos operativos y disminuir los tiempos de cómputo.

GAISSALabel permitirá a los desarrolladores de modelos de IA:

- Monitorear el consumo energético y generar informes detallados.

- Identificar áreas de mejora para, a la hora de programar, reducir el consumo energético del entrenamiento e inferencia de modelos ML.

- Optimizar modelos para hacerlos más eficientes en términos de tiempo y recursos.

Utilizando y siguiendo las recomendaciones de refactorización de la herramienta GAISSALabel, los ingenieros de ML podrán mejorar la eficiencia energética de los sistemas de ML hasta en un 50%, lo cual también permitirá una reducción en el costo económico de los proyectos de ML (por ejemplo, reducción de la factura eléctrica de los centros de datos y HPC).

GAISSALabel proporciona soluciones a tres niveles:

- Social, fomentando el compromiso con la eficiencia energética de los sistemas de ML y permitiendo a los usuarios finales seleccionar y utilizar sistemas de ML sostenibles.

- Para los proveedores de software de ML, dotándolos de los recursos necesarios para desarrollar ML de manera sostenible, con la ayuda de herramientas de gestión y reporte, dentro del marco regulatorio.

- Individual, para ayudar a los científicos de datos e ingenieros de ML a entender y gestionar la eficiencia energética en producción a través de una mayor conciencia y comprensión del consumo energético inherente de los sistemas y herramientas de ML.

El proyecto se inició en diciembre 2022 y finalizará en septiembre de 2025. Cuenta con un presupuesto de 277.035,00 € y está financiado con fondos procedentes del Ministerio de Ciencia e Innovación y Universidades y de Fondos Next Generation de la Unión Europea.

Sector

¿Quieres saber más?

Proyectos Relacionados

- El Grupo de Procesado de Imagen y Vídeo (GPI), vinculado al IDEAI-UPC, y el Grupo en Cultura Digital y Tecnologías Creativas (DiCode) del Centro de la Imagen y la Tecnología Multimedia (CITM) de la Universitat Politècnica de Catalunya – BarcelonaTech (UPC), han coorganizado el AI and Music Festival (S+T+ARTS) junto con el Sónar+D y Betevé, para explorar el uso creativo de la inteligencia artificial en la música.

- El Grupo de Investigación en Visualización, Realidad Virtual e Interacción Gráfica (ViRVIG) de la Universitat Politècnica de Catalunya - BarcelonaTech (UPC) ha participado en el proyecto XR4ED, una iniciativa que conecta los sectores de la tecnología educativa (EdTech) y la Realidad Extendida (XR), con el objetivo de transformar el aprendizaje y la formación en Europa.

- El inLab FIB de la UPC ha colaborado con Lizcore® en el desarrollo de una prueba de concepto basada en inteligencia artificial para mejorar la seguridad en la escalada con autoasegurador, mediante la detección automática y precisa de situaciones de riesgo antes de iniciar la vía.

- Investigadores del Centro de la Imagen y la Tecnología Multimedia de la UPC (CITM) y del grupo de investigación DiCode (Digital Culture and Creative Technologies Research Group) de la Universitat Politècnica de Catalunya – BarcelonaTech (UPC) han trabajado en el proyecto Los ojos de la historia, un proyecto de la Agencia Catalana del Patrimonio Cultural, que propone una mirada inmersiva sobre el patrimonio cultural catalán. Está especialmente dirigido al primer y segundo ciclo de educación secundaria, y tiene como objetivo llevar el patrimonio al aula, acercando la historia y los monumentos de Cataluña de una manera vivencial e innovadora, utilizando herramientas como la realidad virtual y nuevos relatos museográficos.